Αν και η Τεχνητή Νοημοσύνη φέρνει πολλά πλεονεκτήματα, όπως πολλές τεχνολογικές δυνατότητες, εντούτοις εισάγει και έναν ορισμένο αριθμό κινδύνων. Στην έρευνα αποκαλύφθηκαν διαφορετικά επίπεδα ευαισθητοποίησης που σχετίζονται με αυτές τις πιθανές παγίδες.

Ενημέρωση για τους κινδύνους της AI

Κίνδυνοι για την άμυνα: Κακή ποιότητα και ανεπαρκώς εφαρμοσμένη Τεχνητή Νοημοσύνη

Με τη βελτιωμένη προστασία από τις κυβερνοαπειλές να βρίσκεται συνολικά στην κορυφή της λίστας με τα επιθυμητά οφέλη από την GenAI, είναι σαφές ότι ο μετριασμός των κινδύνων για την κυβερνοασφάλεια αποτελεί τον βασικότερο παράγοντα πίσω από την υιοθέτηση των λύσεων άμυνας με Τεχνητή Νοημοσύνη.

Τα κακής ποιότητας και ανεπαρκώς εφαρμοσμένα μοντέλα Τεχνητής Νοημοσύνης ωστόσο ενδέχεται να εισάγουν ακούσια σημαντικούς κινδύνους για την κυβερνοασφάλεια και το ρητό «garbage in, garbage out» στη συγκεκριμένη περίπτωση ταιριάζει ιδιαίτερα στην περίπτωση της εφαρμογής της Τεχνητής Νοημοσύνης. Η δημιουργία αποτελεσματικών μοντέλων AI για την ασφάλεια στον κυβερνοχώρο απαιτεί εκτεταμένη κατανόηση τόσο των απειλών όσο και της Τεχνητής Νοημοσύνης.

Οι οργανισμοί βρίσκονται σε μεγάλο βαθμό σε εγρήγορση για τον κίνδυνο που ενέχουν οι κακώς ενσωματωμένες και εφαρμοσμένες λύσεις Τεχνητής Νοημοσύνης σε προϊόντα και λύσεις κυβερνοασφαλείας. Η συντριπτική πλειονότητα (89%) των επαγγελματιών πληροφορικής/ κυβερνοασφάλειας που συμμετείχαν στην έρευνα εξέφρασαν την ανησυχία τους για το ενδεχόμενο να υπάρχουν ελαττώματα στα χαρακτηριστικά παραγωγικής Τεχνητής Νοημοσύνης που βρίσκονται στα εργαλεία κυβερνοασφάλειας που θα μπορούσαν βλάψουν τον οργανισμό τους, με το 43% να δηλώνει ότι ανησυχεί πολύ και το 46% να δηλώνει ότι ανησυχεί σε κάποιο βαθμό.

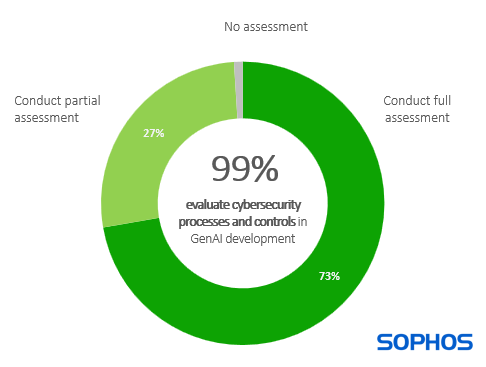

Επομένως, δεν προκαλεί έκπληξη το γεγονός ότι το 99% των οργανισμών δηλώνει ότι όταν εξετάζουν τις δυνατότητες GenAI σε λύσεις κυβερνοασφάλειας, αξιολογεί το επίπεδο και την ποιότητα των διαδικασιών και ελέγχων κυβερνοασφάλειας που χρησιμοποιήθηκαν στην ανάπτυξη της GenAI: το 73% δηλώνει ότι αξιολογεί πλήρως την ποιότητα και το επίπεδο των διαδικασιών και ελέγχων κυβερνοασφάλειας και το 27% ότι το αξιολογεί μερικώς.

Αν και το υψηλό ποσοστό που αναφέρει ότι διενεργεί πλήρη αξιολόγηση μοιάζει ενθαρρυντικό με την πρώτη ματιά, εντούτοις στην πραγματικότητα υποδηλώνει ότι για πολλούς οργανισμούς υπάρχει ένα πραγματικό τυφλό σημείο στον συγκεκριμένο τομέα.

Η αξιολόγηση των διαδικασιών και των ελέγχων που χρησιμοποιούνται για την ανάπτυξη δυνατοτήτων GenAI απαιτεί διαφάνεια από τον πάροχο/ προμηθευτή και έναν εύλογο βαθμό γνώσης της Τεχνητής Νοημοσύνης από εκείνον που την αξιολογεί. Δυστυχώς, και στα δύο, παρατηρείται ανεπάρκεια. Οι πάροχοι λύσεων σπάνια καθιστούν εύκολα διαθέσιμες τις πλήρεις διαδικασίες ανάπτυξης της GenAI και οι ομάδες πληροφορικής συχνά έχουν περιορισμένες γνώσεις σχετικά με τις βέλτιστες πρακτικές ανάπτυξης AI. Για πολλούς οργανισμούς, η διαπίστωση αυτή υποδηλώνει ότι «δεν γνωρίζουν ότι δεν γνωρίζουν».

Οικονομικοί κίνδυνοι: Κακή απόδοση επένδυσης

Όπως είδαμε και παραπάνω, η βελτιωμένη απόδοση της επένδυσης στην κυβερνοασφάλεια (ROI) βρίσκεται επίσης στην κορυφή της λίστας με τα οφέλη που επιδιώκουν να αποκομίσουν οι οργανισμοί μέσω της γενεσιουργού Τεχνητής Νοημοσύνης (GenAI).

Οι δυνατότητες GenAI υψηλού διαμετρήματος (υψηλής ποιότητας και επιπέδου) στις λύσεις κυβερνοασφάλειας είναι δαπανηρές τόσο στην ανάπτυξη όσο και στη συντήρηση. Οι ηγέτες από τον τομέα της πληροφορικής και της κυβερνοασφάλειας σε επιχειρήσεις όλων των μεγεθών βρίσκονται σε εγρήγορση για τις συνέπειες αυτής της δαπάνης ανάπτυξης, με το 80% να δηλώνει ότι σύμφωνα με την άποψη του η GenAI θα αυξήσει σημαντικά το κόστος των προϊόντων κυβερνοασφάλειας.

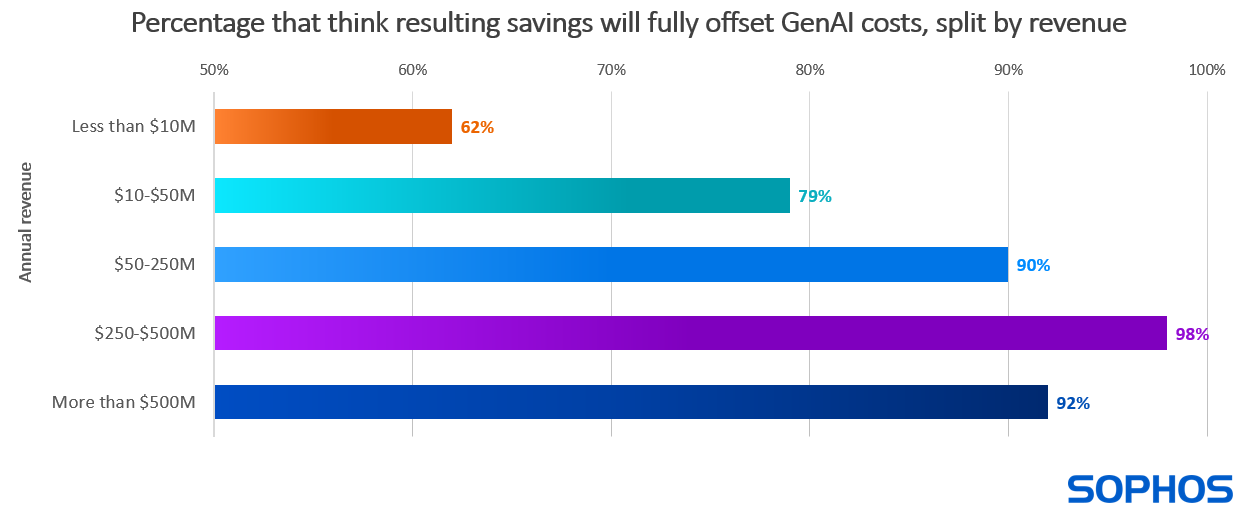

Παρά τις προσδοκίες αυτές για αύξηση των τιμών, οι περισσότεροι οργανισμοί βλέπουν το GenAI ως μία οδό για τη μείωση των συνολικών δαπανών τους στην κυβερνοασφάλεια, με το 87% των ερωτηθέντων να δηλώνουν βέβαιοι ότι το κόστος του GenAI στα εργαλεία κυβερνοασφαλείας θα αντισταθμιστεί πλήρως από τη μείωση στις δαπάνες που θα προσφέρει.

Εμβαθύνοντας λίγο περισσότερο, βλέπουμε ότι η εμπιστοσύνη στην επίτευξη θετικής απόδοσης της επένδυσης αυξάνεται ανάλογα με τα ετήσια έσοδα, με τους μεγαλύτερους οργανισμούς (500 εκατ. δολάρια και άνω) σε ποσοστό 48% να συμφωνούν ή να συμφωνούν απολύτως ότι το κόστος της παραγωγικής ή γενεσιουργού Τεχνητής Νοημοσύνης στα εργαλεία κυβερνοασφάλειας θα αντισταθμιστεί πλήρως από την εξοικονόμηση που θα προσφέρει, σε σχέση με τους μικρότερους (κάτω των 10 εκατ. δολαρίων).

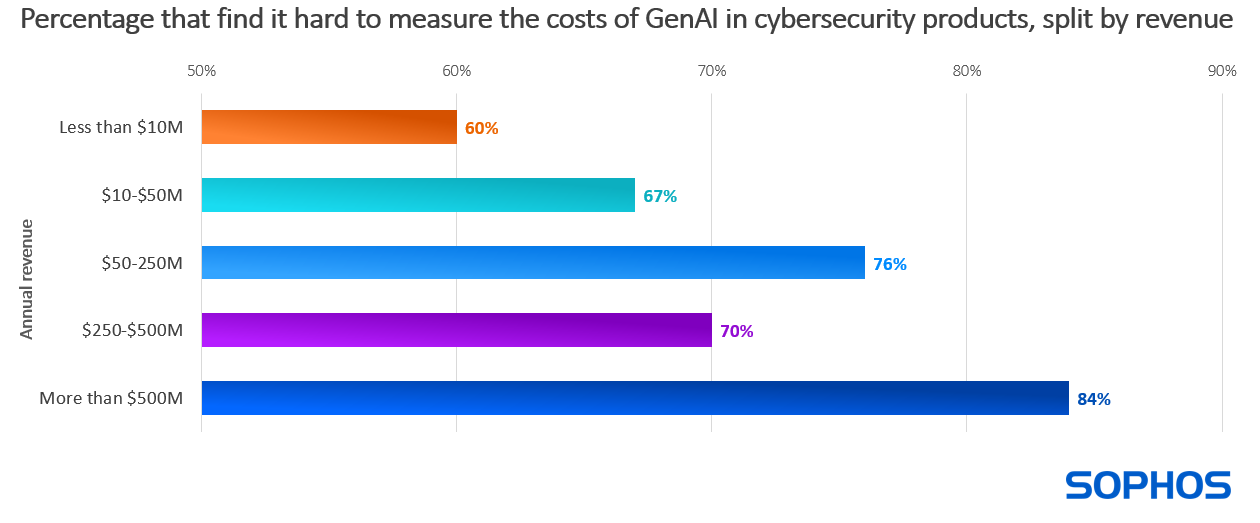

Ταυτόχρονα, οι οργανισμοί αναγνωρίζουν ότι η ποσοτικοποίηση αυτών των δαπανών αποτελεί πρόκληση. Τα έξοδα GenAI ενσωματώνονται συνήθως στη συνολική τιμή των προϊόντων και υπηρεσιών κυβερνοασφάλειας, γεγονός που καθιστά δύσκολο να προσδιοριστεί το ποσό που δαπανούν οι οργανισμοί για να απολαμβάνουν τα οφέλη της GenAI στην κυβερνοασφάλεια. Αντανακλώντας την συγκεκριμένη έλλειψη ορατότητας, το 75% συμφωνεί ότι οι δαπάνες αυτές είναι δύσκολο να μετρηθούν (39% συμφωνούν απόλυτα, 36% συμφωνούν κάπως).

Σε γενικές γραμμές, οι προκλήσεις στην ποσοτικοποίηση του κόστους αυξάνονται επίσης με τα έσοδα: οι οργανισμοί με ετήσια έσοδα 500 εκατ. δολαρίων και άνω είναι 40% πιο πιθανό να θεωρούν δύσκολο να ποσοτικοποιήσουν ή να μετρήσουν το κόστος από εκείνους με έσοδα μικρότερα των 10 εκατ. δολαρίων. Αυτή η διαφοροποίηση ενδέχεται να οφείλεται κατά μέρος στην τάση των μεγαλύτερων οργανισμών να διαθέτουν πιο σύνθετες και εκτεταμένες υποδομές πληροφορικής και κυβερνοασφαλείας.

Χωρίς αποτελεσματικό reporting, οι οργανισμοί κινδυνεύουν να μην δουν την επιθυμητή απόδοση των επενδύσεων τους στην Τεχνητή Νοημοσύνη για την ασφάλεια τους στον κυβερνοχώρο ή, ακόμη χειρότερα, να κατευθύνουν επενδύσεις στην Τεχνητή Νοημοσύνη που θα μπορούσαν να δαπανηθούν αποτελεσματικότερα αλλού.

Λειτουργικοί κίνδυνοι: Υπερβολική εξάρτηση από την Τεχνητή Νοημοσύνη

Η υπερβατική φύση της Τεχνητής Νοημοσύνης καθιστά εύκολο για κάποιον οργανισμό να καταφύγει στην AI, να εναποθέσει όλες τις ελπίδες του για την ασφάλεια σε αυτή, να υποθέσει επίσης ότι είναι πάντα σωστή και ότι μπορεί να κάνει ορισμένες εργασίες καλύτερα από τους ανθρώπους. Ευτυχώς, οι περισσότεροι οργανισμοί έχουν επίγνωση και ανησυχούν για τις συνέπειες της υπερβολικής εξάρτησης από την Τεχνητή Νοημοσύνη στην κυβερνοασφάλεια:

- Το 84% ανησυχεί για την πίεση που προκύπτει από τη μείωση του αριθμού των επαγγελματιών κυβερνοασφάλειας (42% ανησυχεί εξαιρετικά, 41% ανησυχεί κάπως).

- Το 87% ανησυχεί για την επακόλουθη έλλειψη υπευθυνότητας στον τομέα της κυβερνοασφάλειας (37% ανησυχεί εξαιρετικά, 50% ανησυχεί κάπως).

Οι ανησυχίες αυτές είναι ευρέως αισθητές, με τα ποσοστά να είναι σταθερά υψηλά από τους ερωτηθέντες σε όλα τα τμήματα και τους βιομηχανικούς κλάδους, ανεξαρτήτως μεγέθους.

Συστάσεις

Παρόλο που η Τεχνητή Νοημοσύνη εγκυμονεί κινδύνους, με μια προσεκτική προσέγγιση, οι οργανισμοί μπορούν να τους ξεπεράσουν και να επωφεληθούν με ασφάλεια από τις δυνατότητες της Τεχνητής Νοημοσύνης για να ενισχύσουν την κυβερνοάμυνα τους και τα συνολικά επιχειρηματικά τους αποτελέσματα.

Οι παρακάτω συστάσεις παρέχουν ένα σημείο εκκίνησης για να βοηθήσουν τους οργανισμούς να μετριάσουν τους κινδύνους που διερευνώνται στην παρούσα έκθεση.

Ρωτήστε τις εταιρείες ανάπτυξης, προμηθευτές και παρόχους πως αναπτύσσουν τις δυνατότητες/χαρακτηριστικά Τεχνητής Νοημοσύνης τους

- Δεδομένα εκπαίδευσης. Ποια είναι η ποιότητα, η ποσότητα και η πηγή των δεδομένων στα οποία εκπαιδεύονται τα μοντέλα; Οι καλύτερες εισροές οδηγούν σε καλύτερες εκροές.

- Ομάδα ανάπτυξης. Μάθετε για τους ανθρώπους που βρίσκονται πίσω από τα μοντέλα. Ποιο είναι το επίπεδο της τεχνογνωσίας που διαθέτουν σε θέματα AI; Πόσο καλά γνωρίζουν τις απειλές, τις συμπεριφορές των αντιπάλων και τις επιχειρήσεις ασφαλείας;

- Διαδικασία σχεδιασμού και ανάπτυξης προϊόντων. Ποια είναι τα βήματα που ακολουθεί η κάθε εταιρεία κατά την ανάπτυξη και την εγκατάσταση χαρακτηριστικών AI στις λύσεις του; Ποιες διαδικασίες και έλεγχοι εφαρμόζονται;

Εφαρμογή επιχειρηματικής αυστηρότητας στις επενδυτικές αποφάσεις Τεχνητής Νοημοσύνης

- Θέστε στόχους. Να είστε ξεκάθαροι, συγκεκριμένοι και λεπτομερείς σχετικά με τα αποτελέσματα που θέλετε να προσφέρει η Τεχνητή Νοημοσύνη.

- Ποσοτικοποιήστε τα οφέλη. Κατανοήστε πόση διαφορά αναμένετε να κάνουν οι επενδύσεις σε AI.

- Προτεραιοποιήστε τις επενδύσεις σας. Η Τεχνητή Νοημοσύνη μπορεί να βοηθήσει με πολλούς τρόπους- ορισμένες θα έχουν μεγαλύτερο αντίκτυπο από άλλες. Προσδιορίστε τις σημαντικές μετρήσεις για τον οργανισμό σας – μείωση δαπανών, επιπτώσεις από τη φθορά του προσωπικού, μείωση της έκθεσης κ.λπ. – και συγκρίνετε πως συγκρίνονται και κατατάσσονται μεταξύ τους οι διάφορες επιλογές σας.

- Μετρήστε τον αντίκτυπο. Φροντίστε να μάθετε πως η πραγματική απόδοση σχετίζεται με τις αρχικές προσδοκίες σας. Αξιοποιήστε αυτά τα δεδομένα για να προβείτε σε τυχόν προσαρμογές αν απαιτηθούν.

Δείτε την Τεχνητή Νοημοσύνη υπό ανθρωποκεντρικό πρίσμα

- Διατηρήστε τις προοπτικές σας. Η Τεχνητή Νοημοσύνη είναι μόνο ένα στοιχείο της εργαλειοθήκης σας όσον αφορά την κυβερνοάμυνα. Χρησιμοποιήστε το, αλλά ξεκαθαρίστε ότι η υπευθυνότητα για την ασφάλεια στον κυβερνοχώρο είναι στην τελική ανθρώπινη ευθύνη.

- Μην αντικαθιστάτε, επιταχύνετε. Επικεντρωθείτε στο πως η Τεχνητή Νοημοσύνη μπορεί να υποστηρίξει το προσωπικό σας, αναλαμβάνοντας πολλά χαμηλού επιπέδου, επαναλαμβανόμενα καθήκοντα επιχειρήσεων/ λειτουργιών ασφαλείας και παρέχοντας καθοδηγούμενη γνώση.

Σχετικά με την έρευνα

Η Sophos ανέθεσε στην ανεξάρτητη εταιρεία ερευνών Vanson Bourne να διεξάγει έρευνα σε 400 υπεύθυνους για την ασφάλεια ΙΤ σε οργανισμούς με 50 έως 3.000 υπαλλήλους κατά τη διάρκεια του Νοεμβρίου 2024. Όλοι οι ερωτηθέντες εργάζονταν στον ιδιωτικό ή φιλανθρωπικό/μη κερδοσκοπικό τομέα και χρησιμοποιούν σήμερα λύσεις ασφάλειας τερματικών συσκευών (Endpoint Security) από 19 ξεχωριστούς προμηθευτές και 14 παρόχους MDR.

Οι AI–powered λύσεις κυβερνοάμυνας της Sophos

Η Sophos διευρύνει τα όρια της καθοδηγούμενης από την AI κυβερνοασφάλειας σχεδόν για μία δεκαετία. Οι τεχνολογίες AI και η ανθρώπινη τεχνογνωσία στον τομέα της κυβερνοασφάλειας συνεργάζονται για να σταματήσουν το ευρύτερο φάσμα απειλών, όπου κι αν τρέχουν. Οι δυνατότητες AI βρίσκονται ενσωματωμένες σε όλα τα προϊόντα και τις υπηρεσίες της Sophos και παρέχονται μέσω της μεγαλύτερης AI-native πλατφόρμας στον κλάδο.

Για να μάθετε περισσότερα σχετικά με τις κυβερνοάμυνες της Sophos που βασίζονται στην τεχνητή νοημοσύνη, επισκεφθείτε τη διεύθυνση www.sophos.com/ai.

Πηγή: Sophos